Korniza NVIDIA NeMo

Specifikimet

- Emri i produktit: Korniza NVIDIA NeMo

- Platformat e prekura: Windows, Linux, macOS

- Versionet e prekura: Të gjitha versionet para 24

- Dobësia e sigurisë: CVE-2025-23360

- Rezultati bazë i vlerësimit të rrezikut: 7.1 (CVSS v3.1)

Udhëzimet e përdorimit të produktit

Instalimi i përditësimit të sigurisë:

Për të mbrojtur sistemin tuaj, ndiqni këto hapa:

- Shkarkoni versionin më të fundit nga faqja e lëshimeve të NeMo-Framework-Launcher në GitHub.

- Shkoni te Siguria e produktit NVIDIA për informacione të mëtejshme.

Detajet e përditësimit të sigurisë:

Përditësimi i sigurisë trajton një dobësi në kornizën NVIDIA NeMo që mund të çojë në ekzekutimin e kodit dhe të dhënat tamperingë.

Përmirësimi i softuerit:

Nëse jeni duke përdorur një version më të hershëm të degës, rekomandohet të përmirësoni në versionin më të fundit të degës për të adresuar çështjen e sigurisë.

Mbiview

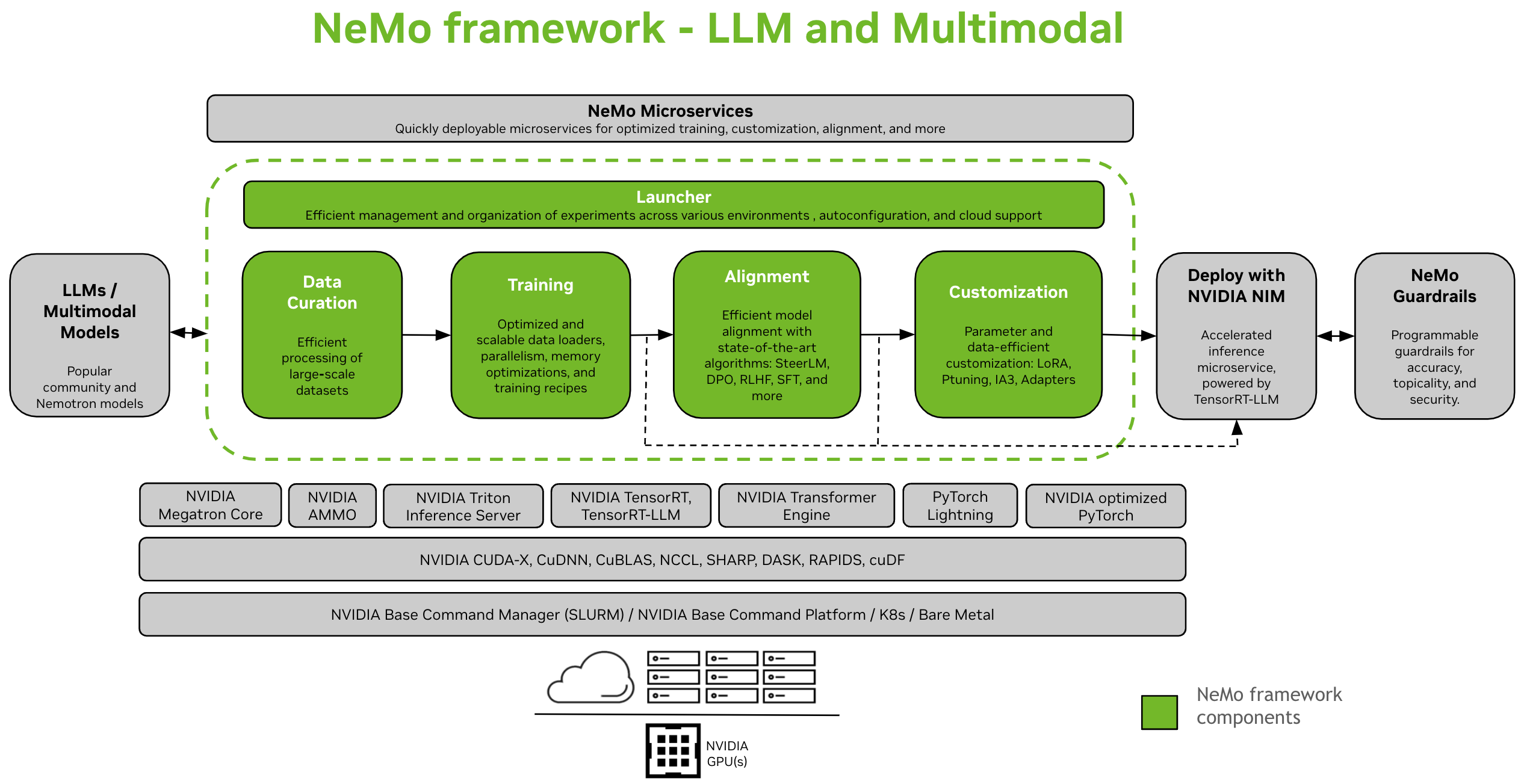

NVIDIA NeMo Framework është një kornizë e shkallëzueshme dhe gjeneruese e inteligjencës artificiale në renë kompjuterike e ndërtuar për studiuesit dhe zhvilluesit që punojnë në Modele të mëdha gjuhësore, Multimodal, dhe AI i të folurit (p.sh Njohja automatike e të folurit dhe Tekst në të folur). Ai u mundëson përdoruesve të krijojnë, personalizojnë dhe vendosin në mënyrë efikase modele të reja gjeneruese të AI duke përdorur kodin ekzistues dhe pikat e kontrollit të modeleve të para-trajnuara.

Udhëzimet e konfigurimit: Instaloni NeMo Framework

Korniza NeMo ofron mbështetje nga fundi në fund për zhvillimin e Modeleve të Gjuhës së Madhe (LLM) dhe Modeleve Multimodalale (MM). Ai siguron fleksibilitetin për t'u përdorur në ambiente, në një qendër të dhënash ose me ofruesin tuaj të preferuar të resë kompjuterike. Ai gjithashtu mbështet ekzekutimin në mjedise të aktivizuara SLURM ose Kubernetes.

Kurimi i të dhënave

Kuratori NeMo [1] është një bibliotekë Python që përfshin një grup modulesh për nxjerrjen e të dhënave dhe gjenerimin e të dhënave sintetike. Ato janë të shkallëzueshme dhe të optimizuara për GPU, duke i bërë ato ideale për kurimin e të dhënave të gjuhës natyrore për të trajnuar ose rregulluar mirë LLM-të. Me NeMo Curator, ju mund të nxirrni me efikasitet tekst me cilësi të lartë nga të papërpunuara të gjera web burimet e të dhënave.

Trajnim dhe personalizim

NeMo Framework ofron mjete për trajnim efikas dhe personalizim të LLM dhe modelet multimodale. Ai përfshin konfigurime të paracaktuara për konfigurimin e grupeve llogaritëse, shkarkimin e të dhënave dhe hiperparametrat e modelit, të cilët mund të rregullohen për t'u trajnuar në grupe të dhënash dhe modele të reja. Përveç trajnimit paraprak, NeMo mbështet si teknikat e Rregullimit të Bukura të Mbikëqyrura (SFT) ashtu edhe të Rregullimit të Përsosur Efikas me Parametrat (PEFT) si LoRA, Ptuning dhe më shumë.

Dy opsione janë të disponueshme për të nisur trajnimin në NeMo – duke përdorur ndërfaqen NeMo 2.0 API ose me NeMo Run.

- Me NeMo Run (rekomandohet): NeMo Run ofron një ndërfaqe për të thjeshtuar konfigurimin, ekzekutimin dhe menaxhimin e eksperimenteve në mjedise të ndryshme llogaritëse. Kjo përfshin nisjen e punëve në stacionin tuaj të punës në nivel lokal ose në grupe të mëdha – të dyja të aktivizuara SLURM ose Kubernetes në një mjedis cloud.

- Para-stërvitja dhe fillimi i shpejtë PEFT me NeMo Run

- Përdorimi i API-së NeMo 2.0: Kjo metodë funksionon mirë me një konfigurim të thjeshtë që përfshin modele të vogla, ose nëse jeni të interesuar të shkruani ngarkuesin tuaj të personalizuar të të dhënave, unazat e trajnimit ose të ndryshoni shtresat e modelit. Ai ju jep më shumë fleksibilitet dhe kontroll mbi konfigurimet, dhe e bën të lehtë zgjerimin dhe personalizimin e konfigurimeve në mënyrë programore.

-

Traduke hyrë në Fillimin e shpejtë me NeMo 2.0 API

-

Migrimi nga NeMo 1.0 në NeMo 2.0 API

-

Rreshtimi

- NeMo-Aligner [1] është një paketë mjetesh të shkallëzueshme për shtrirje efikase të modeleve. Paketa e veglave ka mbështetje për algoritmet më të fundit të shtrirjes së modeleve si SteerLM, DPO, Përforcimi i Mësimit nga Human Feedback (RLHF) dhe shumë më tepër. Këta algoritme u mundësojnë përdoruesve të harmonizojnë modelet e gjuhës për të qenë më të sigurt, të padëmshëm dhe të dobishëm.

- Të gjitha pikat e kontrollit NeMo-Aligner janë të përputhshme me ekosistemin NeMo, duke lejuar përshtatje të mëtejshme dhe vendosje konkluzionesh.

Rrjedha e punës hap pas hapi e të tre fazave të RLHF në një model të vogël GPT-2B:

- Trajnimi SFT

- Trajnimi i modelit të shpërblimit

- Trajnim PPO

Përveç kësaj, ne demonstrojmë mbështetje për metoda të tjera të reja të rreshtimit:

- DPO: një algoritëm i lehtë i shtrirjes në krahasim me RLHF me një funksion më të thjeshtë humbjeje.

- Vetë-Luaj Rregullimi i imët (SPIN)

- SteerLM: një teknikë e bazuar në SFT të kushtëzuar, me dalje të drejtuar.

Shikoni dokumentacionin për më shumë informacion: Dokumentacioni i shtrirjes

Modelet multimodale

- NeMo Framework ofron softuer të optimizuar për të trajnuar dhe vendosur modele multimodale moderne në disa kategori: Modele gjuhësore multimodale, bazat e gjuhës vizion, modele tekst-në-imazh dhe përtej Gjenerimit 2D duke përdorur Fushat e Rrezatimit Neural (NeRF).

- Secila kategori është projektuar për t'iu përgjigjur nevojave dhe avancimeve specifike në fushë, duke shfrytëzuar modelet më të avancuara për të trajtuar një gamë të gjerë të llojeve të të dhënave, duke përfshirë tekstin, imazhet dhe modelet 3D.

Shënim

Ne po migrojmë mbështetjen për modelet multimodale nga NeMo 1.0 në NeMo 2.0. Nëse dëshironi të eksploroni këtë domen ndërkohë, ju lutemi referojuni dokumentacionit për lëshimin e NeMo 24.07 (i mëparshëm).

Vendosja dhe përfundimi

Korniza NeMo ofron shtigje të ndryshme për përfundimin e LLM, duke u kujdesur për skenarë të ndryshëm të vendosjes dhe nevoja të performancës.

Vendoseni me NVIDIA NIM

- NeMo Framework integrohet pa probleme me mjetet e vendosjes së modelit të nivelit të ndërmarrjes përmes NVIDIA NIM. Ky integrim mundësohet nga NVIDIA TensorRT-LLM, duke siguruar përfundime të optimizuara dhe të shkallëzueshme.

- Për më shumë informacion mbi NIM, vizitoni NVIDIA webfaqe.

Vendoseni me TensorRT-LLM ose vLLM

- NeMo Framework ofron skripta dhe API për të eksportuar modele në dy biblioteka të optimizuara me konkluzionet, TensorRT-LLM dhe vLLM, dhe për të vendosur modelin e eksportuar me Serverin NVIDIA Triton Inference.

- Për skenarët që kërkojnë performancë të optimizuar, modelet NeMo mund të përdorin TensorRT-LLM, një bibliotekë e specializuar për përshpejtimin dhe optimizimin e konkluzioneve LLM në GPU-të NVIDIA. Ky proces përfshin konvertimin e modeleve NeMo në një format të pajtueshëm me TensorRT-LLM duke përdorur modulin nemo.export.

- Përfundimi i vendosjes së LLMview

- Vendosni modele të mëdha gjuhësore NeMo me NIM

- Vendosni modele të mëdha gjuhësore NeMo me TensorRT-LLM

- Vendosni modele të mëdha gjuhësore NeMo me vLLM

Modelet e mbështetura

Modele të mëdha gjuhësore

| Modele të mëdha gjuhësore | Paratrajnim & SFT | PEFT | Rreshtimi | Konvergjenca e trajnimit FP8 | TRT/TRTLLM | Konverto në & Nga Fytyrë përqafuese | Vlerësimi |

|---|---|---|---|---|---|---|---|

| Llama3 8B/70B, Llama3.1 405B | po | po | x | Po (i verifikuar pjesërisht) | po | te dyja | po |

| Mikstrale 8x7B/8x22B | po | po | x | Po (i pa verifikuar) | po | te dyja | po |

| Nemotron 3 8B | po | x | x | Po (i pa verifikuar) | x | te dyja | po |

| Nemotron 4 340B | po | x | x | Po (i pa verifikuar) | x | te dyja | po |

| Baichuan2 7B | po | po | x | Po (i pa verifikuar) | x | te dyja | po |

| ChatGLM3 6B | po | po | x | Po (i pa verifikuar) | x | te dyja | po |

| Gemma 2B/7B | po | po | x | Po (i pa verifikuar) | po | te dyja | po |

| Gemma2 2B/9B/27B | po | po | x | Po (i pa verifikuar) | x | te dyja | po |

| Mamba2 130M/370M/780M/1.3B/2.7B/8B/ Hybrid-8B | po | po | x | Po (i pa verifikuar) | x | x | po |

| Phi3 mini 4k | x | po | x | Po (i pa verifikuar) | x | x | x |

| Qwen2 0.5B/1.5B/7B/72B | po | po | x | Po (i pa verifikuar) | po | te dyja | po |

| StarCoder 15B | po | po | x | Po (i pa verifikuar) | po | te dyja | po |

| StarCoder2 3B/7B/15B | po | po | x | Po (i pa verifikuar) | po | te dyja | po |

| BERT 110M/340M | po | po | x | Po (i pa verifikuar) | x | te dyja | x |

| T5 220M/3B/11B | po | po | x | x | x | x | x |

Modelet e gjuhës së vizionit

| Modelet e gjuhës së vizionit | Paratrajnim & SFT | PEFT | Rreshtimi | Konvergjenca e trajnimit FP8 | TRT/TRTLLM | Konverto në & Nga Fytyrë përqafuese | Vlerësimi |

|---|---|---|---|---|---|---|---|

| NeVA (LLaVA 1.5) | po | po | x | Po (i pa verifikuar) | x | Nga | x |

| Llama 3.2 Vizioni 11B/90B | po | po | x | Po (i pa verifikuar) | x | Nga | x |

| LLaVA Tjetra (LLaVA 1.6) | po | po | x | Po (i pa verifikuar) | x | Nga | x |

Embedding Modele

| Embedding Modele Gjuhësore | Paratrajnim & SFT | PEFT | Rreshtimi | Konvergjenca e trajnimit FP8 | TRT/TRTLLM | Konverto në & Nga Fytyrë përqafuese | Vlerësimi |

|---|---|---|---|---|---|---|---|

| SBERT 340M | po | x | x | Po (i pa verifikuar) | x | te dyja | x |

| Llama 3.2 Embedding 1B | po | x | x | Po (i pa verifikuar) | x | te dyja | x |

Modelet e Fondacionit Botëror

| Modelet e Fondacionit Botëror | Pas Trajnimit | Konkluzion i përshpejtuar |

|---|---|---|

| Cosmos-1.0-Diffusion-Text2World-7B | po | po |

| Cosmos-1.0-Diffusion-Text2World-14B | po | po |

| Cosmos-1.0-Diffusion-Video2World-7B | Së shpejti | Së shpejti |

| Cosmos-1.0-Diffusion-Video2World-14B | Së shpejti | Së shpejti |

| Cosmos-1.0-Autoregressive-4B | po | po |

| Cosmos-1.0-Autoregressive-Video2World-5B | Së shpejti | Së shpejti |

| Cosmos-1.0-Autoregressive-12B | po | po |

| Cosmos-1.0-Autoregressive-Video2World-13B | Së shpejti | Së shpejti |

Shënim

NeMo gjithashtu mbështet trajnimin paraprak si për arkitekturën e difuzionit ashtu edhe për arkitekturën autoregresive text2world modelet e themeleve.

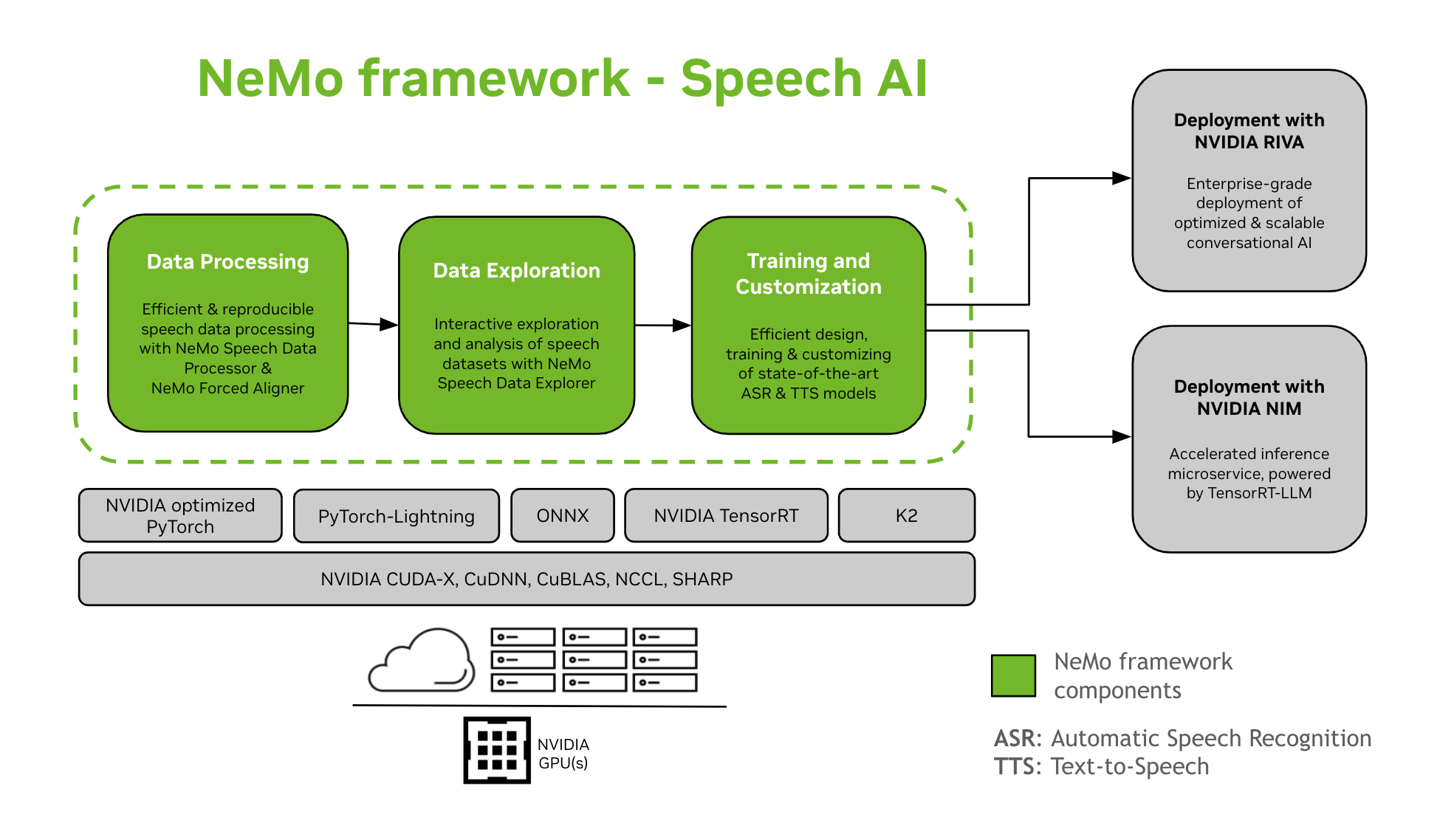

AI i të folurit

Zhvillimi i modeleve bisedore të AI është një proces kompleks që përfshin përcaktimin, ndërtimin dhe trajnimin e modeleve brenda fushave të veçanta. Ky proces zakonisht kërkon disa përsëritje për të arritur një nivel të lartë saktësie. Shpesh përfshin përsëritje të shumta për të arritur saktësi të lartë, rregullim të imët në detyra të ndryshme dhe të dhëna specifike për domenin, duke siguruar performancën e trajnimit dhe përgatitjen e modeleve për vendosjen e konkluzioneve.

NeMo Framework ofron mbështetje për trajnimin dhe personalizimin e modeleve të Speech AI. Kjo përfshin detyra si Njohja automatike e të folurit (ASR) dhe sinteza e tekstit në të folur (TTS). Ai ofron një tranzicion të qetë në vendosjen e prodhimit në nivel ndërmarrje me NVIDIA Riva. Për të ndihmuar zhvilluesit dhe studiuesit, NeMo Framework përfshin pika kontrolli të para-trajnuara më të fundit, mjete për përpunimin e të dhënave të të folurit të riprodhueshëm dhe veçori për eksplorimin dhe analizën ndërvepruese të grupeve të të dhënave të të folurit. Përbërësit e Kornizës NeMo për AI të të folurit janë si më poshtë:

Trajnim dhe personalizim

Korniza NeMo përmban gjithçka që nevojitet për të trajnuar dhe personalizuar modelet e të folurit (ASR, Klasifikimi i të folurit, Njohja e folësit, Diarizimi i folësit, dhe TTS) në mënyrë të riprodhueshme.

Modele të paratrajnuara SOTA

- NeMo Framework ofron receta moderne dhe pika kontrolli të para-trajnuara të disa prej tyre ASR dhe TTS modelet, si dhe udhëzimet se si t'i ngarkoni ato.

- Mjetet e të folurit

- NeMo Framework ofron një sërë mjetesh të dobishme për zhvillimin e modeleve ASR dhe TTS, duke përfshirë:

- NeMo Forced Aligner (NFA) për gjenerimin e kohëzgjatjes së shenjave, fjalëve dhe segmenteveamps të të folurit në audio duke përdorur modelet e Njohjes automatike të të folurit të bazuara në CTC të NeMo.

- Përpunuesi i të dhënave të të folurit (SDP), një paketë veglash për thjeshtimin e përpunimit të të dhënave të të folurit. Kjo ju lejon të përfaqësoni operacionet e përpunimit të të dhënave në një konfigurim file, duke minimizuar kodin e bojlerplate dhe duke lejuar riprodhueshmërinë dhe ndarjen.

- Eksploruesi i të dhënave të të folurit (SDE), i bazuar në Dash web aplikacion për eksplorimin dhe analizën interaktive të grupeve të të dhënave të të folurit.

- Mjet për krijimin e të dhënave i cili ofron funksionalitet për të lidhur audion e gjatë files me transkriptet përkatëse dhe ndani ato në fragmente më të shkurtra që janë të përshtatshme për trajnimin e modelit të Njohjes Automatike të Fjalës (ASR).

- Mjeti i Krahasimit për Modelet ASR për të krahasuar parashikimet e modeleve të ndryshme ASR në nivelin e saktësisë së fjalës dhe të shqiptimit.

- Vlerësues ASR për vlerësimin e performancës së modeleve ASR dhe veçorive të tjera si Zbulimi i aktivitetit zanor.

- Mjeti i normalizimit të tekstit për konvertimin e tekstit nga forma e shkruar në formën e folur dhe anasjelltas (p.sh. “31-ta” kundrejt “tridhjetë e para”).

- Rruga drejt vendosjes

- Modelet NeMo që janë trajnuar ose përshtatur duke përdorur Kornizën NeMo mund të optimizohen dhe vendosen me NVIDIA Riva. Riva ofron kontejnerë dhe diagrame Helm të dizajnuara posaçërisht për të automatizuar hapat për vendosjen e butonave.

Burime të tjera

- NeMo: Depoja kryesore për Kornizën NeMo

- NeMo–Vraponi: Një mjet për të konfiguruar, nisur dhe menaxhuar eksperimentet tuaja të mësimit të makinerive.

- NeMo-Aligner: Paketa e shkallëzueshme e veglave për shtrirje efikase të modeleve

- NeMo-Kurator: Paketa e mjeteve të parapërpunimit dhe kurimit të shkallëzuar të të dhënave për LLM

Angazhohuni me komunitetin NeMo, bëni pyetje, merrni mbështetje ose raportoni gabime.

- Diskutimet e NeMo

- Çështjet e NeMo

Gjuhët dhe Kornizat e Programimit

- Python: Ndërfaqja kryesore për të përdorur Kornizën NeMo

- Pytorch: Korniza NeMo është ndërtuar në krye të PyTorch

Licencat

- Repo NeMo Github është e licencuar nën licencën Apache 2.0

- NeMo Framework është i licencuar sipas MARRËVESHJES SË PRODUKTIT NVIDIA AI. Duke tërhequr dhe përdorur kontejnerin, ju pranoni termat dhe kushtet e kësaj licence.

- Kontejneri NeMo Framework përmban materiale Llama të rregulluara nga Marrëveshja e Licencës Komunitare Meta Llama3.

Fusnotat

Aktualisht, mbështetja e NeMo Curator dhe NeMo Aligner për modelet Multimodal është një punë në progres dhe do të jetë e disponueshme shumë shpejt.

FAQ

Pyetje: Si mund të kontrolloj nëse sistemi im është prekur nga cenueshmëria?

Përgjigje: Mund të kontrolloni nëse sistemi juaj ndikohet duke verifikuar versionin e instaluar të NVIDIA NeMo Framework. Nëse është nën versionin 24, sistemi juaj mund të jetë i cenueshëm.

Pyetje: Kush e raportoi çështjen e sigurisë CVE-2025-23360?

Përgjigje: Çështja e sigurisë u raportua nga Or Peles – JFrog Security. NVIDIA njeh kontributin e tyre.

Pyetje: Si mund të marr njoftimet e buletinit të sigurisë në të ardhmen?

Përgjigje: Vizitoni faqen e Sigurisë së produktit NVIDIA për t'u abonuar në njoftimet e buletinit të sigurisë dhe për të qëndruar i informuar për përditësimet e sigurisë së produktit.

Dokumentet / Burimet

|

Korniza NVIDIA NeMo [pdfUdhëzuesi i përdoruesit Korniza NeMo, NeMo, Korniza |